刚刚,Anthropic给Claude Code加了个语音模式。

以后写代码,用嘴说就行。

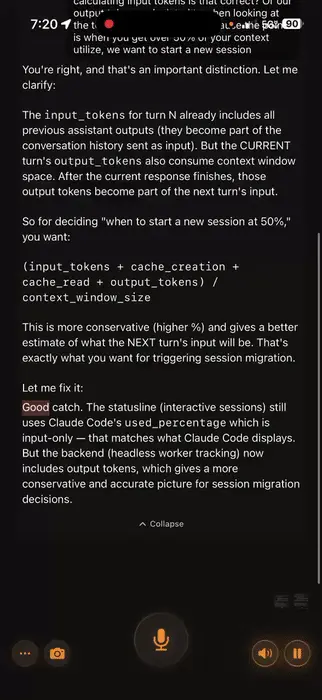

Claude Code是Anthropic出品的命令行AI编程工具。以前你得打字跟它交流。现在不用了。输入/voice命令,开启语音模式。长按空格键说话,松开完成输入。跟对讲机一模一样。

目前灰度测试阶段,大约5%的用户先尝鲜,接下来几周逐步放开如果你的账户有权限,打开Claude Code时欢迎界面会提示你语音模式这玩意儿牛在哪?不是简单的语音转文字语音转出来的文字,会直接在光标位置实时流式输出。

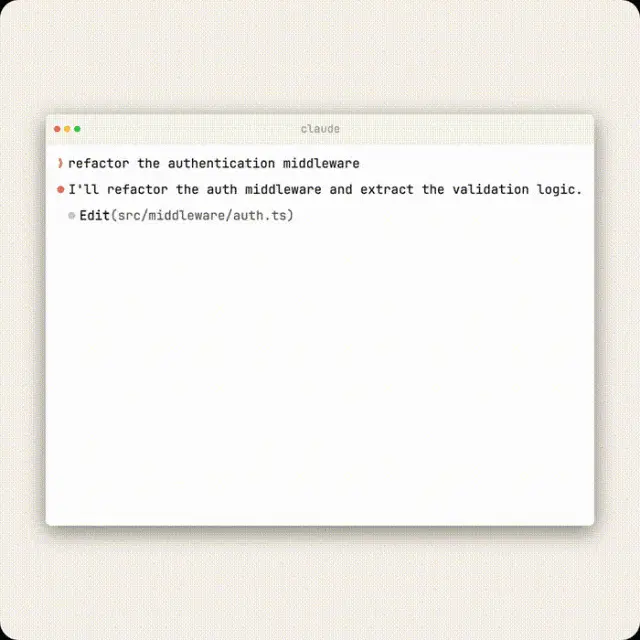

类似下面网友分享的这样。

啥意思呢?你可以先手打一半提示词,遇到复杂逻辑懒得打字了,长按空格切到语音,吐槽一通那段难以描述的逻辑,松手,再继续打字无缝衔接不覆盖不替换这才是关键——它不是替代键盘,是补充键盘想象一个场景:你在调一个诡异的bug,涉及三层回调嵌套加一个竞态条件。

打字描述这玩意儿,光组织语言就得五分钟但如果张嘴说?人类天生就擅长口头描述混乱的场景三十秒搞定还有一个大利好:语音转录的Token完全免费不计费不扣额度想说多少说多少对面奥特曼什么反应?有意思的是,OpenAI的Codex几乎在同一时间也加了类似功能。

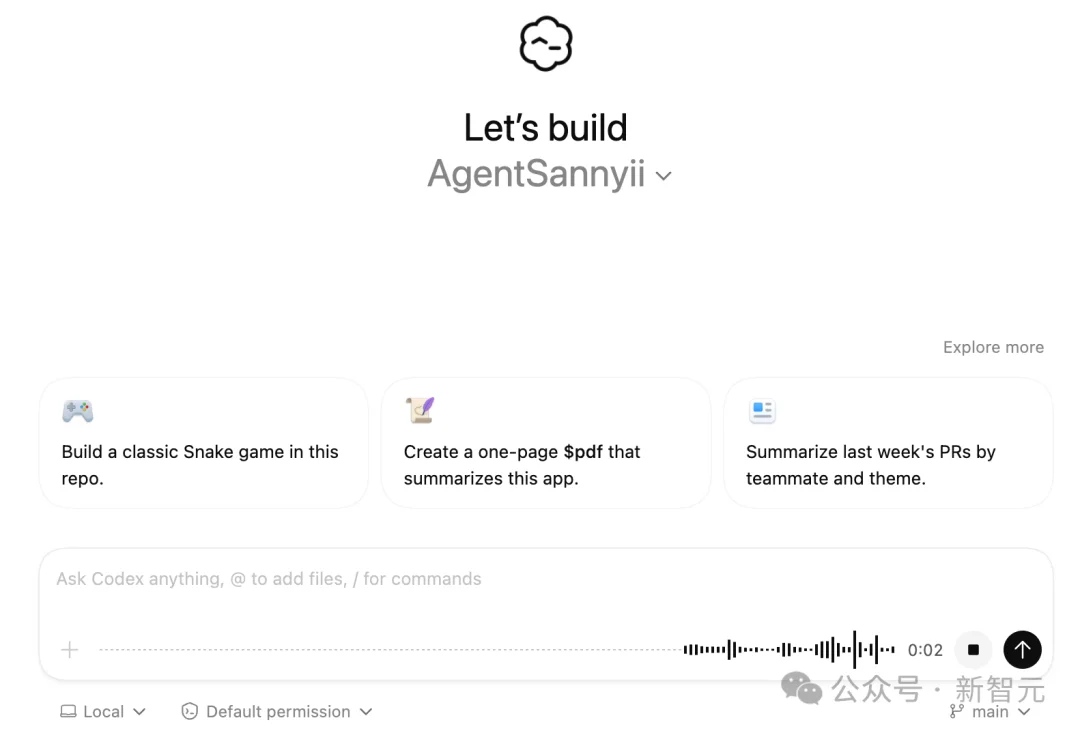

Codex 0.105.0版本更新日志写得明明白白——按住空格录音,松开转录,文字直接输入到终端界面。

用的是Wispr语音引擎,目前支持macOS和Windows,Linux还没跟上而且这功能还需要手动开启:在配置文件里设置features.voice_transcription=true两家几乎同时出招。

这不是巧合,是共识编程工具的下一个战场,不在模型有多聪明,而在交互有多自然社区怎么看?开发者社区其实早就在自己搞了在官方语音模式之前,GitHub上就有一个叫Voice Mode的社区项目,通过MCP协议给Claude Code外挂了语音能力。

用Whisper做语音识别,用Kokoro做语音合成,甚至能离线跑。还有各种第三方工具——AquaVoice、Superwhisper、Voicy——都在抢占语音写代码这个生态位。

有人用Talon Voice实现了全程免手操作,连终端的Ctrl+C都是用嘴说的而现在,官方直接下场了第三方工具颤抖了吗?可能没有因为官方的语音模式更像一个入口级功能——它降低了门槛,让更多人意识到原来写代码可以用嘴。

语音编程的体感到底怎么样?根据早期用户的反馈,几个场景特别好用:Debug的时候口头描述bug比打字描述快太多了你说话时会自然带出更多上下文——就是那个,登录页面,输入带加号的邮箱,它验证就报错了——这种人类碎碎念的信息密度,打字时你绝对懒得写。

架构讨论的时候我想让这个API用JWT做认证,accesstoken十五分钟过期,refreshtoken七天,再加一个刷新端点——说出来十秒钟,打出来一分钟不在电脑前的时候吃东西、喝咖啡、手受伤了、得了腱鞘炎——这些场景下,语音输入不是锦上添花,是刚需。

但也有短板变量名、URL、代码片段,还是得靠打字语音识别对camelCase、下划线命名和各种缩写的识别率仍然不够稳所以最佳实践是:自然语言部分用嘴说,精确代码部分用手打一个更大的信号让我们把视角拉远一点。

2024年,Cursor让AI写代码成为主流,Tab一下是当时的潮流2025年,Claude Code和Codex让AI Agent自主编码成为可能2026年,语音模式的加入,补上了人机交互的最后一块拼图。

编程正在经历一次输入革命键盘不会消失,就像鼠标没有消失一样但编程的主要瓶颈,已经从写代码变成了表达意图而表达意图这件事,人类最原始、最高效的方式,就是说话人类说话的速度大约是每分钟150词,打字速度大约是40词。

这中间3-4倍的差距,就是语音编程要吃掉的市场畅想一下:再往前看几步如果语音输入足够准确,如果AI对代码意图的理解足够深,那编程最终的形态可能是这样的:你坐在沙发上,对着电脑说:把用户模块的权限系统重构一下,改成RBAC模型,别忘了写测试。

AI自动读代码、理解架构、写实现、跑测试、提PR你审一眼diff,说一句LGTM,合并从写代码到说需求,从程序员到编程导演这一天比大多数人想的要近Claude Code的这个/voice命令,就是一个起点。

它可能还很粗糙,可能还有各种小毛病但方向错不了——未来的编程,一定是多模态的键盘、语音、甚至手势和眼动,所有人类自然的表达方式,都会成为编程的输入通道到那时候回头看今天,就像我们现在看二十年前的打孔卡片一样。

会觉得很可爱写代码这件事,终于可以动口不动手了虽然动完口之后,你可能还是得动手改bug参考资料:https://x.com/bcherny/status/2028629573722939789文章来自于微信公众号 “新智元”,作者 “新智元”。