在 AIGC 狂奔的当下,盲目追求全自动化往往会导致误差的指数级放大本文提出基于 HITL(Human-in-the-Loop)的标准化工作流,通过“三道人工闸门”解决幻觉问题,并首创“人机协作率”这一量化指标,帮助产品经理与内容创作者在效率与质量之间找到黄金平衡点。

随着大模型的普及,我们看到了一种危险的倾向:无论是企业应用还是个人创作,大家都在疯狂追求“全自动”我们试图构建一个完美的 Prompt 或 Agent,指望点击一下“生成”,就能得到完美的行业研报或代码工程。

但现实往往是骨感的——产出要么平庸,要么一本正经地胡说八道为什么全自动化在复杂任务中总是失效?作为产品经理,我们该如何设计一套既能利用 AI 效率,又能保证产出质量的标准化 SOP?本文将介绍一套 HITL(Human-in-the-Loop,人机协作)

工作法,并引入**“发布礼仪”与“人机协作率”**两个核心概念,试图为 AI 时代的知识生产建立标准一、 为什么必须 HITL:误差放大与“幻觉复利”在简单的单步任务(如“帮我写个请假条”)中,AI 的表现堪称完美。

但在长链路的复杂任务(如“撰写一份竞品分析报告”)中,完全脱离人工干预的自动化是不可行的核心原因在于:现实任务的 Context(上下文)与 Prompt 无法 100% 覆盖真实目标与隐含约束;而微小的偏差在多步链路里会复合增长。

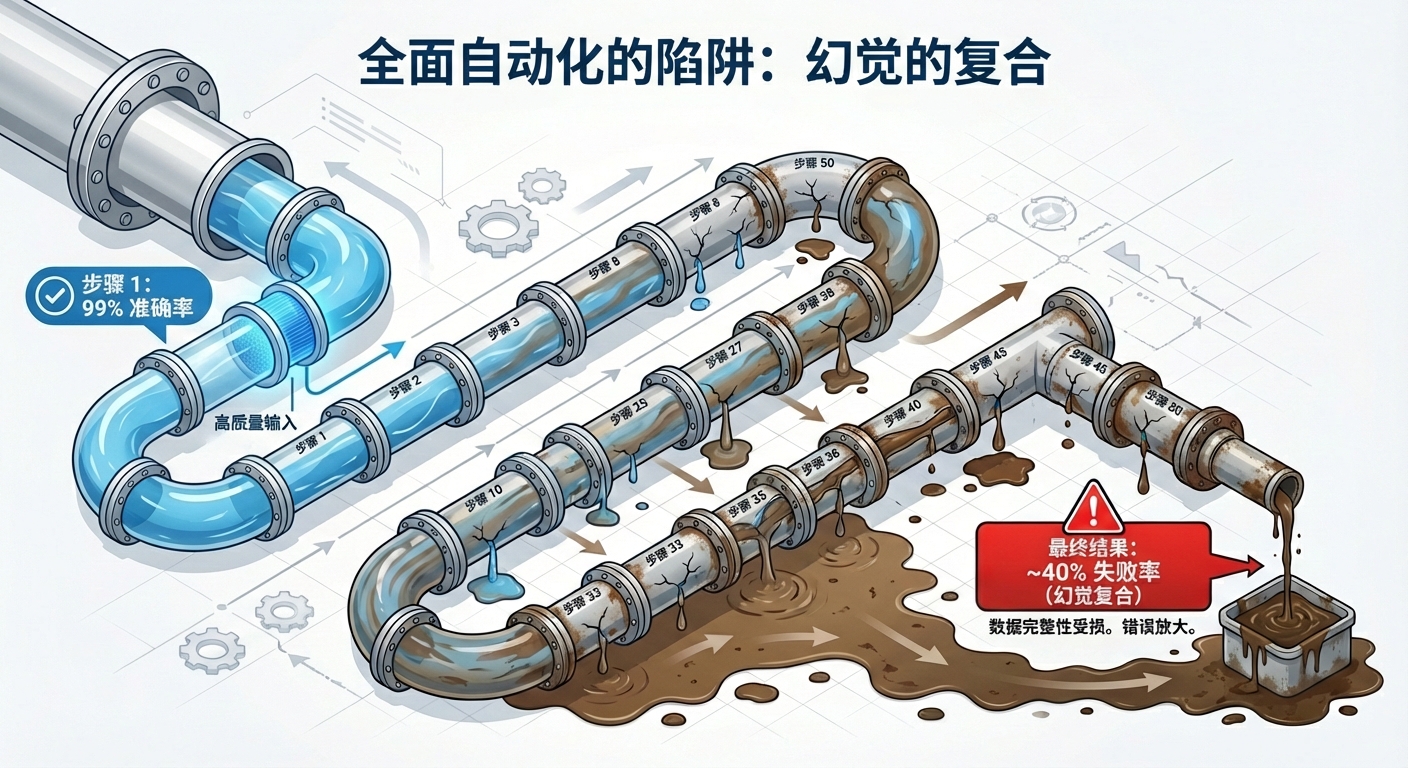

我们可以用一个简单的数学模型来看“幻觉复利”的可怕之处:

假设我们搭建了一个全自动化的 Agent 流程,共需要 50 个步骤完成任务。即使目前最先进的模型能做到单步准确率 99%(即幻觉率仅 1%),在连续 50 步无干预的情况下,最终结果的无错概率为:

这意味着,最终任务的失败率高达 39.5%这就是为什么我们不能盲目依赖自动化在多步推理中,前一步的微小谬误会成为后一步的“错误前提”,最终导致逻辑崩塌因此,我们需要引入 HITL(人机协作)模型人(Human):。

负责设定问题与边界 → 识别与纠偏 → 价值/风险判断 → 最终背书机(AI): 负责资料聚合 → 生成备选方案 → 重复步骤自动化 → 语言与结构优化AI 负责将信息加工到“可用”,人负责确保产出属于“我的观点”。

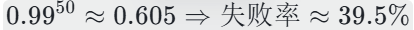

二、 落地 SOP:设置“三道人工闸门”

为了截断误差放大,我们需要在工作流中设置三个关键的“人工闸门”(Human Gates):第一道闸门:Input 层的“问题设定”AI 无法凭空猜测你的隐含意图在输入阶段,人必须完成“定义”工作AI 动作。

:根据模糊指令生成大纲人工干预:确认大纲是否偏题?约束条件(如字数、语气、禁用词)是否明确?价值:防止方向性错误,这是成本最低的纠错环节第二道闸门:Process 层的“识别与纠偏”这是 HITL 的核心。

不要让 AI 一口气跑完 50 步,而是将其拆解为若干个里程碑AI 动作:执行具体模块(如“搜集竞品数据”)人工干预:检查事实准确性(Fact Check)如果 AI 编造了数据,人必须在进入下一步前修正它。

价值:阻断“幻觉复利”,将每一步的准确率重置为 100%第三道闸门:Output 层的“价值背书”AI 动作:生成最终润色后的文本人工干预:合规性审查、风险控制、以及最重要的——确认“这是我愿意签名为之负责的观点”。

价值:建立信任三、 用户体验的重构:生成式时代的“发布礼仪”当我们将视角从“生产者”转向“消费者”或“用户”时,会发现另一个痛点:信息过载与信任危机腾讯研究院 @晓辉博士 曾提出关于“Proof of Thought(思考的证据)”的深刻洞察:。

在生成式时代之前,写作难度高于阅读,“思考的证据”由写作者承担;阅读被视为与伟大灵魂的交流而在生成式时代,写作变得极其廉价“Proof of Thought”的责任被转移到了阅读者身上——读者需要耗费大量精力去分辨这篇文章是 AI 生成的行活,还是作者的真知灼见。

对整篇文章的审阅,反而成了整个链路里最昂贵的人工成本如果我们的产品或内容让用户承担了过高的“验证成本”,这就是糟糕的用户体验(UX)因此,建议所有 AI 辅助的内容生产,都遵循一套 “最高标准发布礼仪”。

。这不仅是道德呼吁,更是建立品牌护城河的手段:按照尊重程度由低到高,我们应提供:

许可说明:明确告知信息接收方,该内容由 AI 辅助生成,获得用户的知情许可PR 对(Prompt + Response):随内容附带生成该内容的 Prompt这相当于开源代码,让读者具备“复现”和“验证”的能力。

人工摘要/重写:这是最高等级的礼仪作者必须亲自撰写核心观点或摘要,证明我在 AI 的基础上投入了“思考算力”四、 企业级指标:像看“自动化率”那样看“人机协作率”在工业时代,我们用“自动化率”来衡量效率。

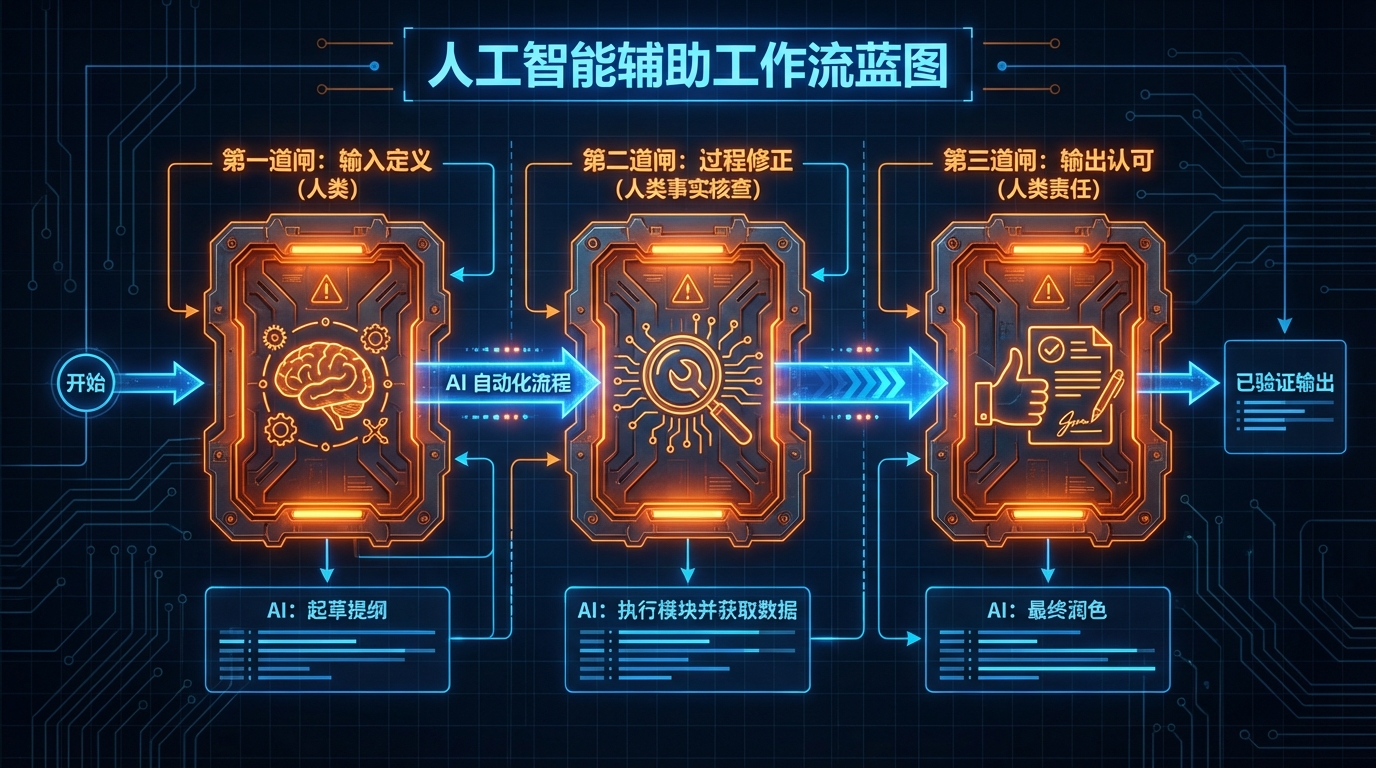

在知识生产领域,产品经理和业务负责人不能只看“产出量”,更需要关注一个新指标——“人机协作率”1. 定义与计算口径在企业落地时,可以选择以下三种口径之一(需保持一致):时间法:AI 执行时长 /(AI+人工总时长)。

适用于咨询、规划等强脑力任务产出法:AI 生成字数或 Token /(AI+人工总字或 Token)适用于 SEO 文章、代码生成等步骤法:流程中由 AI 完成的加权步骤数 / 加权总步骤数适用于标准化的 SaaS 工作流。

2. 警惕“虚高”:与质量指标绑定

协作率不是越高越好100% 的协作率通常意味着 100% 的垃圾内容我们必须将协作率与质量指标“绑在一起”看:质量约束:事实错率(每千字)、人工审校时长、读者反馈(纠错率/满意度)治理原则:在看板中,必须把“协作率—质量—产出周期”三维同屏展示。

3. 参考目标区间不同类型的任务,其合理的“人机协作率”区间是不同的:资料综述类(70%–85%):强调规模化与结构化,AI 是主力,人负责把关观点评论类(40%–60%):强调独特的立场与判断,AI 仅作为辅助。

合规/风控类(20%–40%):强调责任与红线,人必须深度介入结语AI 不应该是人类的替代者,而应该是增幅器在这个内容泛滥的时代,稀缺的不再是文字,而是可信度与独特观点对于产品经理而言,设计产品或工作流时,不应追求盲目的“去人化”,而应致力于设计更优雅的 。

HITL交互。只有当我们将“决定权”与“责任”牢牢握在手中,并量化人机协作的比例时,AI 的效率红利才能真正转化为高质量的生产力。